5.3 kB

MindSpore Serving

概述

MindSpore Serving是一个轻量级、高性能的服务模块,旨在帮助MindSpore开发者在生产环境中高效部署在线推理服务。当用户使用MindSpore完成模型训练后,导出MindSpore模型,即可使用MindSpore Serving创建该模型的推理服务。

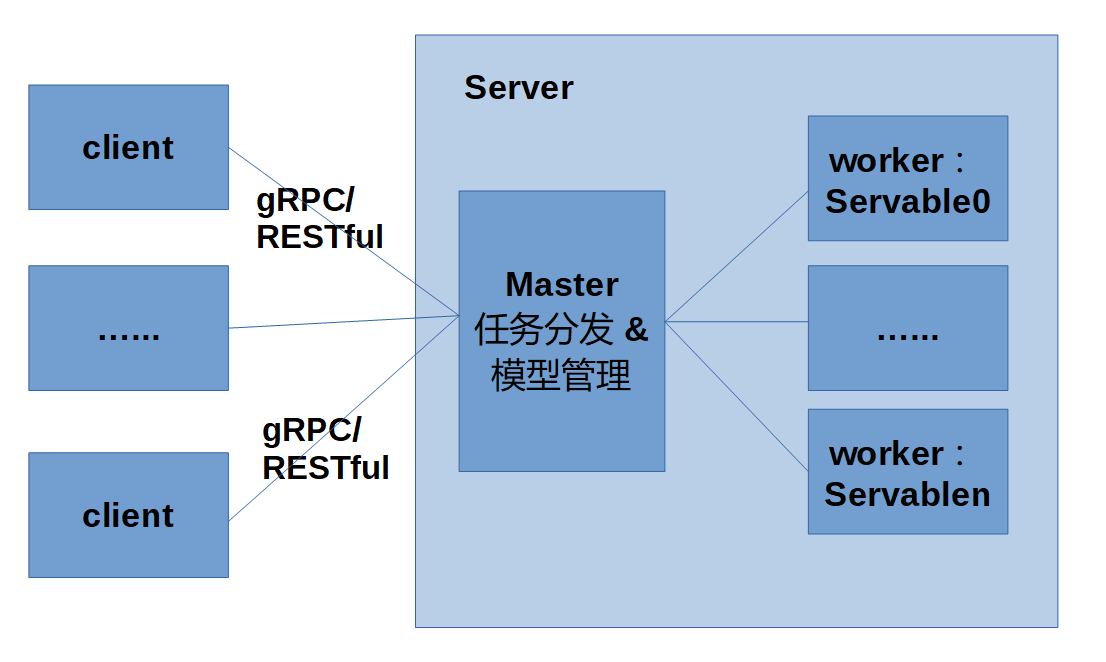

MindSpore Serving架构:

当前MindSpore Serving服务节点分为client,master和worker。client为客户端节点,用户可以直接通过gRPC或RESTful接口方式下发推理服务命令。执行机worker部署了模型服务Servable,这里的Servable可以是单个模型,也可以是多个模型的组合,一个Servable可以通过提供多种方法来提供不同的服务。master节点用来管理所有的执行机worker及其部署的模型信息,并进行任务管理与分发。master和worker可以部署在一个进程中,也可以部署在不同进程中。当前client和master不依赖特定硬件平台,worker节点仅支持Ascend 310和Ascend 910平台,后续会逐步支持GPU和CPU场景。

MindSpore Serving提供以下功能:

- 支持客户端gRPC和RESTful接口。

- 支持组装模型的前处理和后处理。

- 支持batch功能,多实例请求会被拆分组合以满足模型

batch size需要。 - 提供客户端python简易接口。

安装

MindSpore Serving依赖MindSpore训练推理框架,安装完MindSpore ,再安装MindSpore Serving。

安装Serving

使用pip命令安装,安装方式如下:

-

请从MindSpore Serving下载页面下载并安装whl包。

pip install https://ms-release.obs.cn-north-4.myhuaweicloud.com/1.1.0/Serving/ascend/ubuntu_x86/mindspore_serving-1.1.0-cp37-cp37m-linux_x86_64.whl -

源码编译安装。

下载源码,下载后进入

serving目录。方式一,指定Serving依赖的已安装或编译的MindSpore包路径,安装Serving:

sh build.sh -p $MINDSPORE_LIB_PATH其中,

build.sh为serving目录下的编译脚本文件,$MINDSPORE_LIB_PATH为MindSpore软件包的安装路径下的lib路径,例如,softwarepath/mindspore/lib,该路径包含MindSpore运行依赖的库文件。方式二,直接编译Serving,编译时会配套编译MindSpore的包,需要配置MindSpore编译时的环境变量 :

# ascend 310 sh build.sh -e d -V 310 # ascend 910 sh build.sh -e ascend其中,

build.sh为serving目录下的编译脚本文件,编译完后,在serving/build/package/目录下找到whl安装包进行安装:pip install mindspore_serving-1.1.0-cp37-cp37m-linux_x86_64.whl

执行以下命令,验证安装结果。导入python模块不报错即安装成功:

from mindspore_serving import master

from mindspore_serving import worker

配置环境变量

MindSpore Serving运行需要配置以下环境变量:

-

MindSpore Serving依赖MindSpore正确运行,运行MindSpore需要完成环境变量配置。

-

MindSpore Serving依赖MindSpore库文件,需指定MindSpore软件包的编译或安装路径下的

lib路径到LD_LIBRARY_PATH。

export LD_LIBRARY_PATH=$MINDSPORE_LIB_PATH:${LD_LIBRARY_PATH}

快速入门

以一个简单的Add网络示例,演示MindSpore Serving如何使用。

文档

开发者教程

有关安装指南、教程和API的更多详细信息,请参阅用户文档。

社区

治理

查看MindSpore如何进行开放治理。

交流

- MindSpore Slack 开发者交流平台。

贡献

欢迎参与贡献。

版本说明

版本说明请参阅RELEASE。